「重要なページがなかなかインデックスされない」「サイトの更新内容がいつまでも検索結果に反映されない」

このような悩みを抱えているウェブ担当者は少なくないでしょう。

本記事では、クロール最適化の仕組みと8つの具体的な施策、サーチコンソールを使った確認方法について解説しました。

最後まで読めば、Googlebotにとって最適なクロール環境を整えるための具体的な手順が理解でき、すぐに施策を実行できる状態になります。

クロール最適化とは何か|仕組みをわかりやすく解説

クロール最適化とは、Googlebotがウェブサイトを効率よく巡回できるよう、サイト構造や設定を整える一連の取り組みです。

このセクションでは、クロールがSEOに与える影響と、クロールバジェットとの関係を順番に解説します。

具体的には、以下の2つのトピックから解説します。

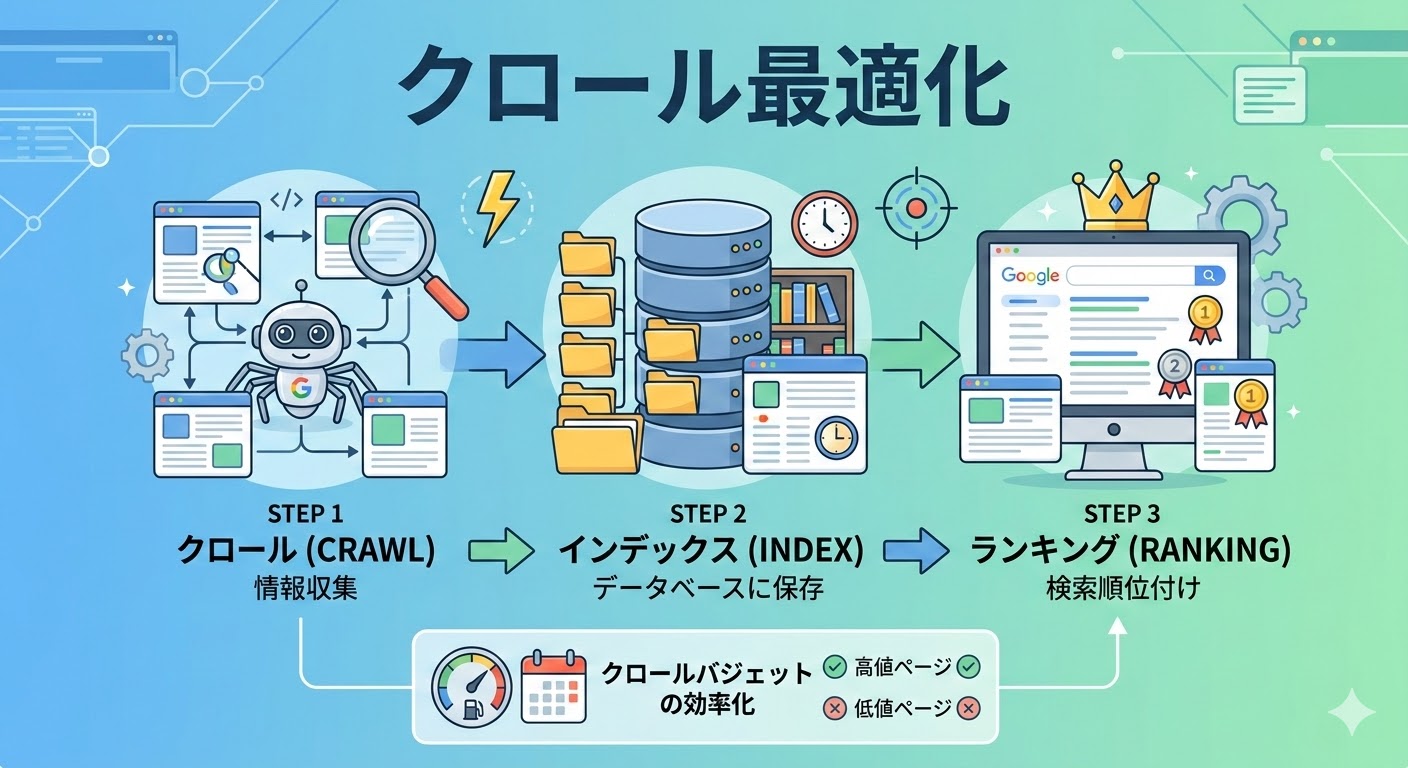

- クロール・インデックス・ランキングの関係

- クロールバジェットとの違いと関係性

それぞれ詳しく見ていきましょう。

クロール・インデックス・ランキングの関係

Googleの検索プロセスは、クロール・インデックス・ランキングの3段階で成り立っています。

クロールとは、Googlebotがウェブページを訪問してテキストや画像などの情報を収集するプロセスです。

収集された情報はGoogleのデータベースに保存(インデックス登録)され、はじめて検索結果の候補になります。

Google検索セントラルによると、GoogleはGooglebotを使用してウェブ上の数十億のページをクロールしており、取得したコンテンツが処理・分析されてインデックスに登録されます。

つまり、クロールが適切に行われないページはインデックスに登録されず、どれだけ優れたコンテンツでも検索結果に現れません。

参考:Google 検索エンジンの仕組み ※「Google の検索エンジンの仕組み」ページより、クロール→インデックス→ランキングの流れを引用

関連記事:SEOの目標の5つの手順を解説!KPIの決め方と進捗管理

クロールバジェットとの違いと関係性

クロール最適化とよく混同される概念に「クロールバジェット」があります。

クロールバジェットとは、Googlebotが一定期間内にサイトに割り当てるクロールのリソースの上限を指す概念です。

クロール最適化はサイト全体の設計や設定を改善してGooglebotが重要ページを巡回しやすくする取り組みであり、クロールバジェットはその結果として効率的に使われるべきリソースそのものを指します。

不要なページへのアクセスが多いと重要なページまで巡回が届かなくなるため、クロール最適化によって無駄なクロールを減らすことが重要です。

クロールバジェットの問題が顕在化しやすいのは、ページ数が数万件を超える大規模サイトやURLが自動生成されるECサイトです。

関連記事:GoogleのSEOガイドライン6選|チェックリスト150個紹介!

クロール最適化が特に重要なサイトの特徴

クロール最適化の必要性は、サイトの規模や特性によって大きく異なります。

ここでは、優先して対応すべき3つのサイトタイプとその理由を解説します。

具体的には、以下の3つのサイト特性に当てはまる場合は優先度が高くなります。

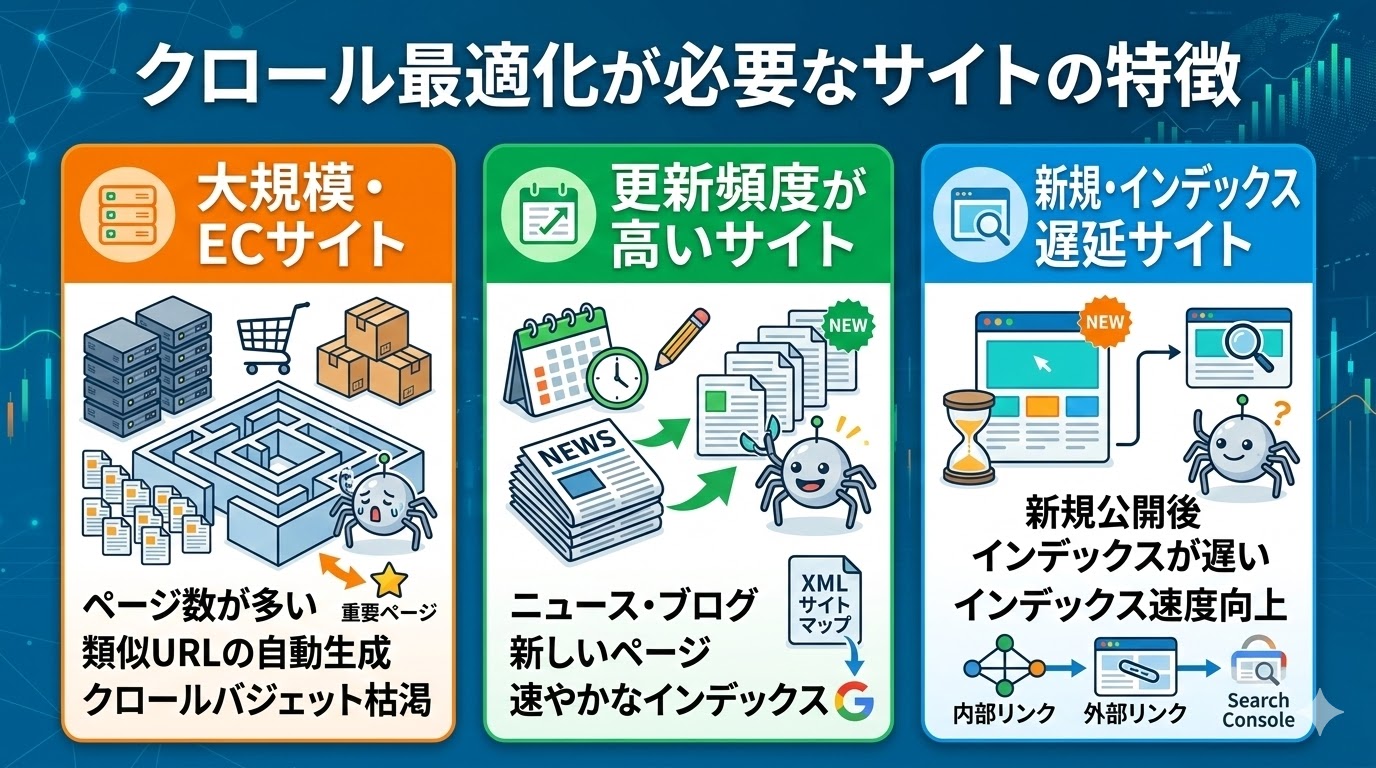

- ページ数が多い大規模サイト・ECサイト

- コンテンツの更新頻度が高いサイト

- 新規公開後のインデックスが遅いサイト

それぞれ順番に確認しましょう。

ページ数が多い大規模サイト・ECサイト

ページ数が数万件以上になる大規模サイトやECサイトは、クロールバジェットを使い果たしてしまうリスクが特に高いサイトです。

商品のカラー・サイズ違いや絞り込み検索によって、同一商品の類似URLが大量に自動生成されることがあります。

このような状況では、Googlebotが重要な商品詳細ページや新着ページにたどり着く前に、価値の低い類似ページのクロールにリソースを使い切ってしまう可能性があります。

ECサイトやポータルサイトでは、重要ページへのクロールが集中するようなURLの設計が特に重要です。

インデックスされていないページが大量にある場合は、まずサーチコンソールでカバレッジの状況を確認することを推奨します。

関連記事:SEOのおすすめChrome拡張機能20選!初心者からプロも愛用

コンテンツの更新頻度が高いサイト

ニュースサイトやブログのように、日々コンテンツを更新・追加しているサイトは、新しいページが速やかにインデックスされることが成果に直結します。

Googlebotはサイトの更新頻度や人気シグナルを参考にクロールの優先度を決定するため、頻繁に更新されるサイトほどクロール環境を整えておく意義が大きくなります。

一方で、更新頻度が高くても低品質なコンテンツが増え続けると、サイト全体の評価が下がってクロール優先度が落ちることがあります。

更新コンテンツを速やかに検索結果へ反映させるためには、XMLサイトマップを適時更新してGoogleに変更を通知することが重要な手順のひとつです。

コンテンツの質を維持しながら更新頻度を高めることが、クロール最適化と検索パフォーマンスの両方を底上げするうえで不可欠です。

関連記事:オウンドメディアのSEO対策5選!内部SEOとAI対策も解説します

新規公開後のインデックスが遅いサイト

サイトを新規公開してもなかなかページがインデックスされない場合、クロール最適化が後回しになっている可能性が高いです。

新規サイトはGoogleのデータベースに蓄積されたクロール履歴がないため、Googlebotが定期的に巡回するまでにある程度の時間がかかります。

この期間を短縮するには、XMLサイトマップをサーチコンソールに送信し、内部リンクで各ページへの導線を整えることが有効です。

また、外部サイトからリンクを獲得することでGooglebotが辿り着きやすくなり、インデックス登録が早まる傾向があります。

インデックスが進まない状態が長期間続く場合は、サーチコンソールのURL検査ツールで個別に状況を確認し、問題の原因を特定するようにしましょう。

関連記事:GoogleのSEOガイドライン6選|チェックリスト150個紹介!

Googleサーチコンソールでクロール状況を確認する方法

クロール最適化を進めるにあたって、まず現状を把握することが不可欠です。

Googleサーチコンソールには、クロールの問題を診断するための便利な機能が備わっています。

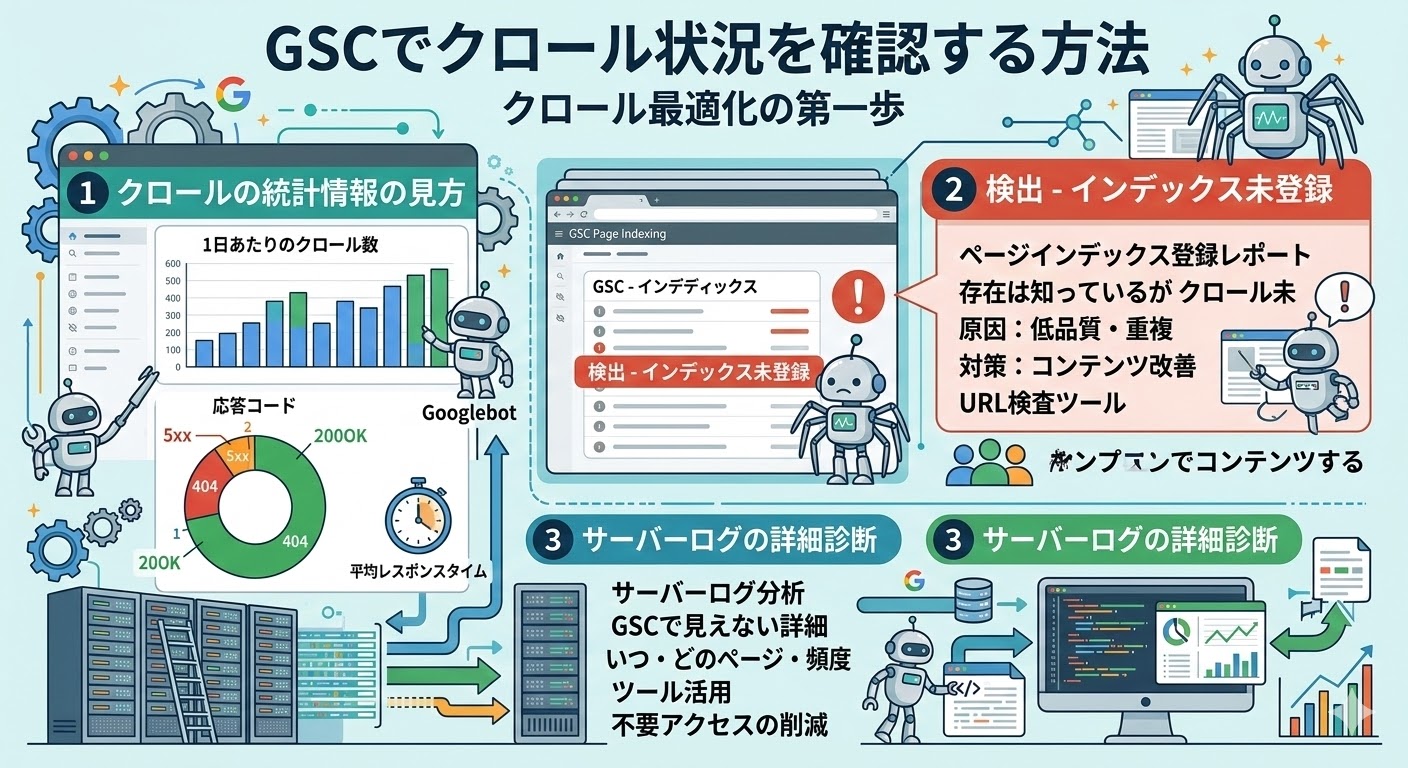

ここでは、以下の3つの確認方法に絞って解説します。

- クロールの統計情報の見方

- 「検出 - インデックス未登録」が示す問題

- サーバーログを使った詳細な診断方法

順番に確認していきましょう。

クロールの統計情報の見方

Googleサーチコンソールの「設定」から「クロールの統計情報」を開くと、Googlebotがサイトをどのくらいの頻度で巡回しているかを確認できます。

確認するポイントは主に、1日あたりのクロール数・クロールリクエストへの応答コードの内訳・平均レスポンスタイムの3つです。

応答コードの「200(成功)」の割合が低く「404(Not Found)」や「5xx(サーバーエラー)」が多い場合は、クロールバジェットが無駄に消費されているサインです。

Google Search Consoleのヘルプによると、クロールの統計情報レポートのホストのステータス判定でサイトの可用性に関する問題も確認できます。

定期的にこのレポートを確認することで、クロール環境の異常に早期に気づき、問題の悪化を防ぐことができます。

参考:ページ インデックス登録レポート - Search Console ヘルプ ※「クロールの統計情報レポート」セクションより、ホストのステータス判定によるサイト可用性の確認方法を引用

関連記事:SEOのおすすめChrome拡張機能20選!初心者からプロも愛用

「検出 - インデックス未登録」が示す問題

サーチコンソールのページインデックス登録レポートで「検出 - インデックス未登録」が多く表示されている場合、Googlebotがサイトの存在は知っているもののクロールに来ていない状態を意味します。

これは通常、サイトへの過負荷が予想されたためクロールが先送りされているか、ページの優先度が低いとGoogleに判断されていることを示しています。

「検出 - インデックス未登録」が大量に発生している場合は、低品質なページや重複コンテンツが多く蓄積されていることが根本的な原因として考えられます。

まずURL検査ツールでインデックス登録のリクエストを行い、並行して不要なページの整理とコンテンツの改善を進めることが正しい対処の順序です。

この問題を放置すると重要なコンテンツのインデックスが遅延し、新しいページが検索結果に現れるまでの時間が大幅に延びる可能性があります。

関連記事:SEOの目標の5つの手順を解説!KPIの決め方と進捗管理

サーバーログを使った詳細な診断方法

サーチコンソールだけでは把握できない詳細なクロール状況を確認するために、サーバーログ分析が有効な手段になります。

サーバーログにはGooglebotがいつ・どのページに・どのくらいの頻度でアクセスしたかが記録されており、クロールバジェットがどのページに使われているかを正確に把握できます。

ログを解析することで、本来クロールが不要な管理画面や検索結果ページへの無駄なアクセスが発生していないかを検証できます。

サーバーログの分析には、Screaming Frogのログアナライザーや専用のBIツールを活用することが一般的です。

ログ分析で得た知見をもとにrobots.txtの設定やサイト構造の改善に反映させることで、より精度の高いクロール最適化が実現します。

関連記事:SEOのおすすめChrome拡張機能20選!初心者からプロも愛用

SEOに効く8つのクロール最適化施策

クロールの現状を把握したら、次は具体的な改善施策を実施します。

このセクションでは、SEO効果の高い8つのクロール最適化施策を、実践的な視点でわかりやすく解説します。

8つの施策は以下の通りです。

- ① robots.txtで不要ページのクロールを制限する

- ② XMLサイトマップを常に最新の状態に保つ

- ③ 重複コンテンツを排除しURLを正規化する

- ④ 内部リンク構造をシンプルに整理する

- ⑤ 404・soft404エラーを適切に処理する

- ⑥ ページの読み込み速度とサーバーレスポンスを改善する

- ⑦ 低品質・薄いコンテンツページを整理・統合する

- ⑧ URLパラメータの生成を最適化する

それぞれの施策について詳しく見ていきましょう。

① robots.txtで不要ページのクロールを制限する

robots.txtは、Googlebotにクロールを許可するページと制限するページを指定するためのテキストファイルです。

管理画面・ログインページ・テスト用ページなど検索結果に表示する必要がないページをDisallowで制限することで、クロールバジェットを重要ページへ集中させられます。

Google検索セントラルによると、Disallowで制限されたページのコンテンツはインデックスに登録されませんが、URLそのものはスニペットなしで検索結果に表示される可能性があります。

そのため、インデックスからも完全に除外したい場合はrobots.txtのDisallowとmetaタグのnoindexを組み合わせることを検討する必要があります。

誤ってサイト全体をDisallowしてしまうと全ページがクロールされなくなるため、設定後は必ずサーチコンソールのURLテストで動作確認を行ってください。

参考:Google による robots.txt の指定の解釈 ※「disallow ルール」セクションより、Disallowで制限したページのURLはインデックス可能という仕様を引用

関連記事:GoogleのSEOガイドライン6選|チェックリスト150個紹介!

② XMLサイトマップを常に最新の状態に保つ

XMLサイトマップとは、サイト内のURLリストをGoogleに伝えるためのファイルであり、Googlebotが新しいページを効率よく発見するための重要な手がかりになります。

ページを追加・削除・URLを変更した際にサイトマップを更新せずに放置すると、存在しないURLや古いURLへのクロールが続きクロールバジェットが無駄になります。

ニュースサイトやECサイトのようにページの追加・削除が頻繁なサイトでは、CMSやスクリプトでサイトマップを自動生成・自動更新する仕組みを導入することが特に効果的です。

サイトマップを更新したら、必ずサーチコンソールの「サイトマップ」セクションで送信し直してGoogleに変更を通知するようにしましょう。

サイトマップにはインデックスさせたいページのみを含め、noindexを設定したページや重複ページはリストから除外するのが正しい管理の基本です。

関連記事:SEOの目標の5つの手順を解説!KPIの決め方と進捗管理

③ 重複コンテンツを排除しURLを正規化する

同一または酷似したコンテンツが複数のURLに存在する「重複コンテンツ」は、クロールバジェットを不要に消費するだけでなく、どのページを検索結果に表示すべきかGoogleが判断できなくなる原因になります。

「http」と「https」の混在、wwwあり・なしの統一不備、末尾スラッシュの有無など、細かな違いで重複が発生しやすいため、早期にcanonical設定による正規化を行うことが重要です。

canonicalタグを正しく設定することでリンク評価が正規URLに集中し、クロール効率の向上と検索順位の改善が同時に期待できます。

また、パラメータ付きURLが大量に生成されているサイトでは、canonicalタグを活用して正規URLを明示する対処が必要です。

重複コンテンツの有無は定期的にサーチコンソールのカバレッジレポートで確認し、「重複です。Google により正規ページが選択されています」のような表示がないかチェックしましょう。

関連記事:カノニカル(canonical)タグとは?SEO効果や設定方法を解説

④ 内部リンク構造をシンプルに整理する

内部リンクはGooglebotがサイト内を巡回する際の主要な経路であり、内部リンクの構造がシンプルに整理されているほどクロールの効率が高まります。

クリックするまでに多くの階層をたどるページはGooglebotにとって重要度が低いと判断される傾向があるため、重要ページへのリンクはできるだけトップページに近い階層から設置することを意識してください。

孤立ページ(どこからもリンクされていないページ)が存在する場合はGooglebotがそのページをなかなか発見できないため、関連性の高いページから適切なアンカーテキストでリンクを設置することが必要です。

パンくずリストやカテゴリページなど、サイト全体の構造を反映したナビゲーションリンクを整えることも、クロール経路の最適化に貢献します。

内部リンクの状態はサイトの規模が大きくなるほど管理が難しくなるため、定期的なサイトクロール診断ツールでの確認を習慣化しましょう。

関連記事:GoogleのSEOガイドライン6選|チェックリスト150個紹介!

⑤ 404・soft404エラーを適切に処理する

404エラー(ページが存在しない)が大量にある場合、Googlebotがそれらのページを繰り返し確認しようとしてクロールバジェットを消費することがあります。

削除したページや移動したページには301リダイレクトを設定して正しいURLに誘導することで、Googlebotへの無駄なクロールを防ぎリンク評価を引き継ぐことができます。

soft404とは、本来存在しないページなのにHTTPステータスコードとして200(成功)を返してしまう状態であり、Googleがインデックスから除外しないため問題が長期化しやすくなります。

soft404の代表例は「該当商品なし」「検索結果0件」などのページが正常ページと同じ200コードで返されているケースで、正しくは404または410ステータスを返す実装が求められます。

エラーページの状況はサーチコンソールの「ページのインデックス登録」レポートで確認でき、定期的なチェックと修正を習慣化することが長期的な品質維持につながります。

関連記事:SEOのおすすめChrome拡張機能20選!初心者からプロも愛用

⑥ ページの読み込み速度とサーバーレスポンスを改善する

ページの読み込み速度とサーバーレスポンスタイムは、クロール最適化においても重要な要素です。

Googlebotはサーバーに過負荷をかけないようにクロール速度を自動調整するため、レスポンスが遅いサーバーではクロール頻度が自動的に下げられてしまいます。

画像の最適化・ブラウザキャッシュの活用・不要なスクリプトの削除・CDNの導入などでサーバーのレスポンスタイムを短縮することで、Googlebotがより多くのページを効率的に巡回できるようになります。

Core Web Vitalsの指標(LCP・FID・CLS)が改善されると、ユーザー体験の向上だけでなくクロールバジェットの有効活用にもつながるという副次的な効果があります。

サーチコンソールの「ウェブに関する主な指標」レポートでページスピードの問題を確認し、特に「不良」と判定されているURLから優先的に改善しましょう。

関連記事:オウンドメディアのSEO対策5選!内部SEOとAI対策も解説します

⑦ 低品質・薄いコンテンツページを整理・統合する

情報量が少ない薄いコンテンツや、内容が重複・類似しているページが多いサイトでは、Googleがサイト全体の品質を低く評価しクロール優先度が下がる可能性があります。

不要なページをnoindexに設定するか削除・統合することで、インデックスされるべき重要ページへクロールバジェットを振り向けることができます。

複数ページに分散している関連コンテンツを一つの充実したページに統合することは、クロールの効率化とともにページ自体の評価向上にもつながる効果的な手段です。

定期的にサーチコンソールの「クロール済み - インデックス未登録」のページ一覧を確認し、薄いコンテンツや重複ページがないか見直す習慣をつけましょう。

ページを削除・統合する際には必ず301リダイレクトを設定し、既存の評価やリンクを引き継ぐことを忘れないことが重要です。

関連記事:GoogleのSEOガイドライン6選|チェックリスト150個紹介!

⑧ URLパラメータの生成を最適化する

URLパラメータとは、URLの末尾に「?sort=price」「?color=red」のような形式で付加される変数であり、サイトによっては同一コンテンツのURLが大量に自動生成される原因になります。

こうして増殖したパラメータ付きURLは重複コンテンツとして扱われるだけでなく、クロールバジェットを大幅に浪費するため、ECサイトやデータベース型サイトで特に問題になりやすいです。

対策としては、重複の原因となるパラメータURLにcanonicalタグを設定して正規URLを明示するか、robots.txtでパラメータURLへのクロールを制限する方法があります。

GoogleサーチコンソールのURL検査ツールでパラメータURLがどのように扱われているかを確認し、不要なパラメータが大量にインデックスされていないかをチェックしましょう。

パラメータ管理が複雑なサイトでは、不要なパラメータをサーバーサイドで取り除いたりアンカータグにパラメータを付けないようコード側で対処することが根本的な解決策になります。

関連記事:カノニカル(canonical)タグとは?SEO効果や設定方法を解説

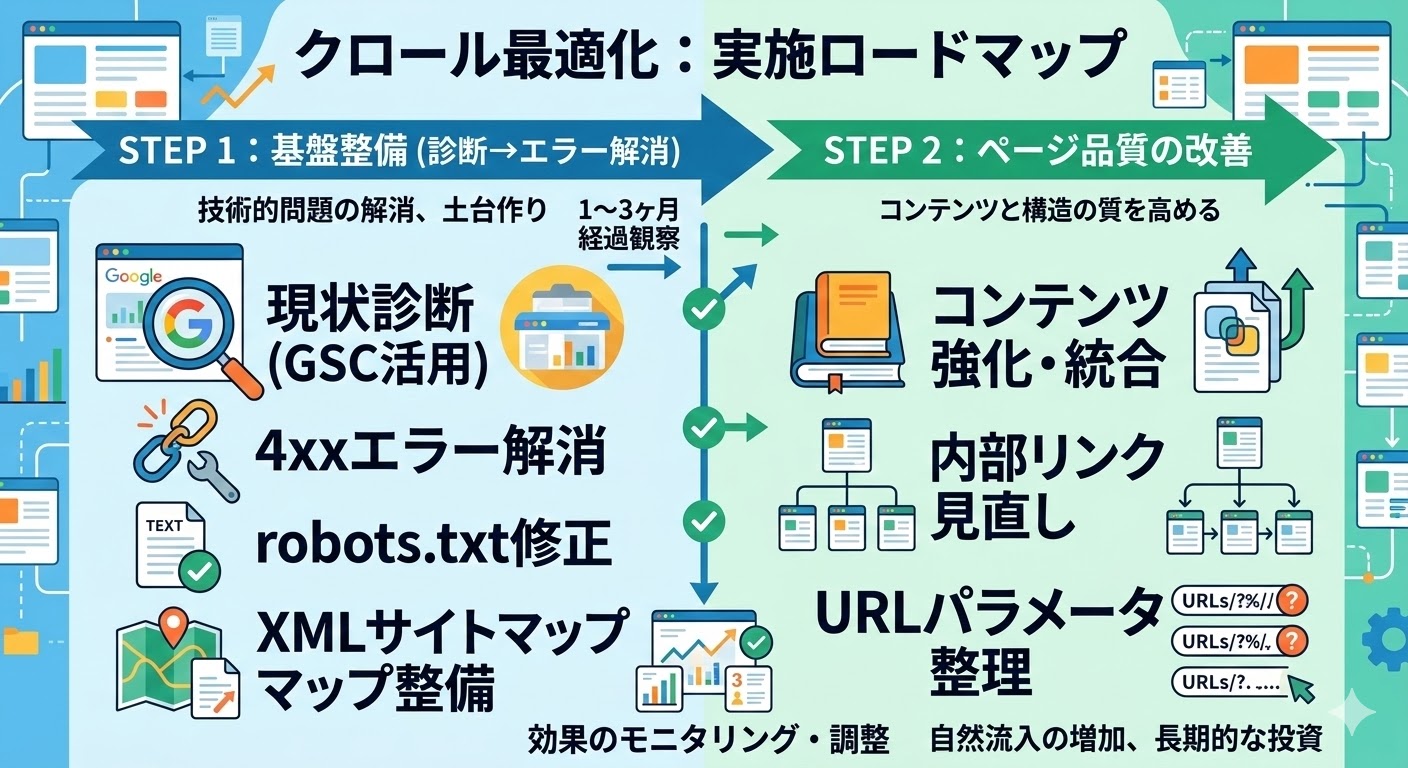

施策の優先順位と実施ロードマップ

8つの施策を同時に進めることは現実的ではなく、サイトの状況に応じて優先順位をつけることが重要です。

まず基盤となる問題を解消し、その後にコンテンツ品質の改善へと順番に取り組むことで、効率的な改善が実現します。

実施ロードマップの大きな流れは、以下の2段階です。

- まず着手すべき基盤整備(診断→エラー解消)

- 次に取り組むページ品質の改善

それぞれの内容を確認しましょう。

まず着手すべき基盤整備(診断→エラー解消)

クロール最適化の第一歩は、現状診断です。

Googleサーチコンソールでクロールの統計情報・ページインデックス登録レポート・Core Web Vitalsを確認し、問題箇所を洗い出してから優先順位をつけて対処します。

基盤整備として最初に取り組むべきなのは、大量の4xxエラーの解消、robots.txtの設定ミスの修正、XMLサイトマップの整備の3つです。

これらは比較的短期間で対応可能な技術的問題であり、修正によってGooglebotがサイトを正しく巡回できる状態を整えることがその後の施策の土台になります。

エラー解消後はインデックスの状況が改善されるまで1〜3か月程度を目安に経過観察を続け、効果を数値で確認してから次のフェーズに進むのが確実です。

関連記事:SEOの目標の5つの手順を解説!KPIの決め方と進捗管理

次に取り組むページ品質の改善

基盤整備が完了しクロールエラーが減少したら、次のフェーズとしてページ品質の改善に集中します。

具体的には、薄いコンテンツの強化・重複ページの統合・内部リンクの見直し・URLパラメータの整理など、コンテンツと構造の両面から改善を進めていきます。

ページ品質の改善は基盤整備よりも時間を要しますが、長期的な検索順位の安定と自然流入の増加に直結する重要な投資です。

改善の効果はサーチコンソールのクロール統計・インデックス数・検索パフォーマンスレポートで継続的にモニタリングし、数値の変化に応じて施策を調整するようにしましょう。

ページ品質の向上を通じてクロールバジェットの無駄が減ると、サイト全体のインデックス率が高まり新規コンテンツが検索結果に反映されるまでの時間が短縮される好循環が生まれます。

関連記事:SEOはオワコン?その理由とAI普及時代の生き残り戦略

クロール最適化に関するよくある質問

クロール最適化のよくある質問について解説します。

小規模サイトでもクロール最適化は必要?

小規模サイトの場合、クロールバジェットの枯渇はほぼ問題になりません。

ただし、robots.txtの設定ミスや重複コンテンツ、サイトマップの未送信などの基本的な設定の不備はどのサイトにも影響するため、最低限の確認と設定は行うべきです。

特に新規サイトの場合は、サイトマップの送信と内部リンクの整備を行うだけでもインデックス速度の改善が期待できます。

robots.txtでブロックするとインデックスにも影響する?

robots.txtのDisallowでクロールをブロックしたページは、そのコンテンツをGoogleが読めないためインデックスには登録されません。

ただし、外部リンクなどからURLの存在が知られている場合は、コンテンツなしでURLだけがスニペットなしで検索結果に表示されることがあります。

インデックス自体を防ぎたい場合はnoindexタグを使い、クロールのブロックは「クロールバジェットの節約」という目的に限定して活用することが正しい使い分けの基本です。

noindexとrobots.txtのdisallowはどう使い分ける?

robots.txtのDisallowは「クロール自体を制限したい」場合に、noindexは「クロールはさせるがインデックスには登録させない」場合に使います。

管理画面や開発中のページなどユーザーに見せる必要がないページにはDisallowが適しており、類似ページや薄いコンテンツのインデックス除外にはnoindexが適しています。

なお、Disallowで制限したページにnoindexを設定しても、Googlebotがページにアクセスできないためnoindexの指示を読み取れず、意図通りに機能しない点に注意が必要です。

クロール最適化の効果はいつ頃から確認できる?

robots.txtのエラー修正やサイトマップの送信といった技術的な対応は、数日から数週間でサーチコンソールのクロール統計に変化が現れることがあります。

一方、コンテンツの整理・統合や内部リンクの見直しといった構造的な改善は、効果が検索順位に反映されるまで1〜3か月程度を見込むのが現実的です。

定期的にサーチコンソールの統計情報と検索パフォーマンスレポートを比較し、施策の前後で数値がどう変化したかを記録しながら改善を続けることを推奨します。

まとめ|サーチコンソールで現状確認から始めよう

本記事では、クロール最適化の仕組みと、robots.txtの設定からXMLサイトマップの整備・重複コンテンツの解消まで、SEOに効く8つの施策について解説しました。

クロール最適化はSEOの土台となる技術的施策であり、どれだけ優れたコンテンツを用意しても、Googlebotが適切にサイトを巡回できなければ検索結果に反映されません。

まずはGoogleサーチコンソールでクロールの統計情報とページインデックス登録レポートを確認し、エラーや問題点を洗い出すことから始めましょう。

基盤となる技術的問題を解消してから、コンテンツ品質の改善や内部リンクの整備といった中長期的な施策に順番に取り組むことで、クロール環境は着実に改善されます。

今日からできる一歩は、サーチコンソールを開いてクロールの統計情報を確認することです。